【Global Fact 11】生成式AI助力 打造更強查證聊天機器人

記者何蕙安/塞拉耶佛報導;責任編輯/陳偉婷

巴西查核組織《Aos Fatos》近日發布新一代的生成式AI聊天機器人「Fátima 3.0」,以類似ChatGPT的問答功能,將查核報告的內容以更生動的對話方式回覆給查詢訊息的用戶。不只是巴西,從台灣、印度,到土耳其,全球有愈來愈多查核組織嘗試將生成式AI技術用於打擊錯誤資訊,相關發展令人期待。

今年6月底在塞拉耶佛舉行的第11屆全球事實查核峰會(Global Fact 11)上,國際事實查核聯盟IFCN前副總監塔達戈勒(Cristina Tardáguila)也呼籲全球查核組織合作,共同開發以查核報告為資料庫的「超級聊天機器人」(Super Chatbot),目前已有包括台灣事實查核中心近50家組織響應。

「當我們對抗這個全新、仍在發展的AI技術,我們(查核組織)必須站在一起。」塔達戈勒說。

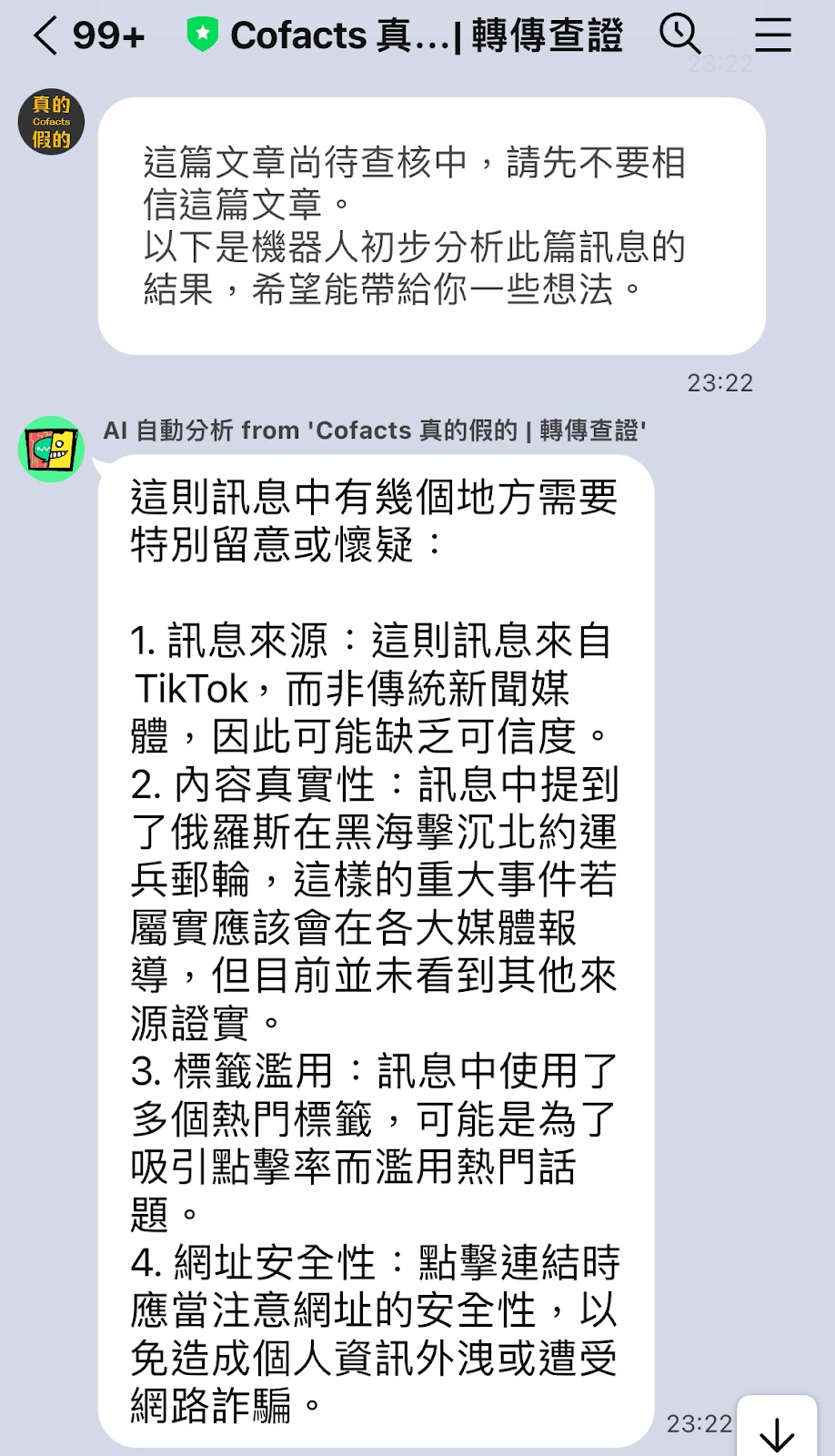

在台灣,公民事實查核項目《cofacts真的假的》也嘗試將AI功能用於聊天機器人。除了使用AI技術進行分類與搜尋,cofacts的聊天機器人也利用生成式AI分析用戶提報的傳言,告知用戶傳言中的可疑之處,並建議可能的查核方式,讓用戶對於訊息保持懷疑態度。

圖1:國際事實查核聯盟IFCN前副總監塔達戈勒(Cristina Tardáguila,圖左)在6月27日在全球事實查核峰會呼籲全球查核組織合作開發聊天機器人。圖右為英國查核組織《Full Fact》的AI團隊主管Andrew Dudfield。(Vanja Čerimagić/Freelance Photographer & Videographer)

生成式AI助陣 查證聊天機器人更好用

查核組織利用聊天機器人對抗錯誤資訊並非新鮮事。為了應對通訊軟體上流傳的錯誤訊息,愈來愈多查核組織在WhatsApp、LINE等通訊軟體建立聊天機器人,提供民眾查詢可疑訊息、並接收查核報告。透過用戶提報的資訊,查核組織也得以了解有哪些訊息正在通訊軟體熱傳。

一般來說,如果民眾提報的訊息曾在過去被查核過,聊天機器人可以即時回覆過去的查核報告,讓民眾得知查核結果,甚至進一步將正確資訊與親友分享。

不過,多數市面上的聊天機器人僅能回覆系統預先設計好的內容。隨著生成式AI技術的躍進與ChatGPT等AI對話工具的問世,讓聊天機器人出現更多可能性。

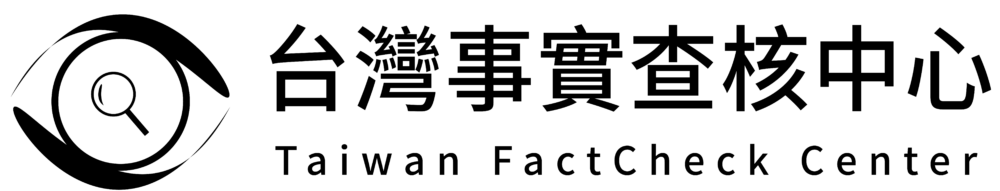

例如《Aos Fatos》9月上旬上線的第三代聊天機器人「Fátima 3.0」,使用生成式AI讓聊天機器人的回覆與對話變得更自然,也更貼近用戶的需求。

此外,「Fátima 3.0」解決了ChatGPT等AI對話工具最為人詬病的問題,即有時會給出錯誤或完全虛構的答案。「Fátima 3.0」使用的大型語言模型的訓練資料庫完全來自《Aos Fatos》發布過的查核報告或文章,聊天機器人生成的對話內容僅限於正確資訊,避免生成式AI技術虛構資訊,也建立一些測試/監控機制確保生成內容的正確性。

圖2:巴西查核組織《Aos Fatos》的第三代WhatsApp聊天機器人「Fátima 3.0」。圖左以葡萄牙文詢問「(美國民主黨總統候選人)賀錦麗是美國人嗎?」聊天機器人即時根據《Aos Fatos》的查核報告給出相關結果,並附上查核報告的連結。圖右以中文詢問相同的問題,「Fátima 3.0」雖然無法給出中文的答案,但能夠翻譯中文問題,以葡萄牙文給出一樣的查核結果。(Fátima 3.0聊天機器人擷圖)

《Aos Fatos》的創新總監Bruno Fávero透露,該團隊2023年11月就推出「Fátima 3.0」的beta版本,經過8個多月的測試,確保內容的可靠性與安全性後才全面開放。

目前《Aos Fatos》主要將「Fátima 3.0」使用於巴西當地熱門的通訊軟體whatsapp與telegram,也可以在《Aos Fatos》網站上使用。目前語言顯示是葡萄牙語。不過,如果以中文來發問,也會得到與葡萄牙語一樣的答案。

全球查核組織合作 打造超級聊天機器人

《Aos Fatos》最新發布的AI聊天機器人也是當前查核組織探討將AI技術用於查核工作的縮影。在今年6月26日至28日在塞拉耶佛舉行的全球事實查核峰會上,相關討論成為最熱門的話題之一,包括《Aos Fatos》在內的多國查核組織也分享了相關的進展與面臨的挑戰。

圖3:AI話題是第11屆事實查核峰會的焦點之一。圖為2024年6月27日、全球事實查核峰會第二天關於事實查核與AI的座談。(照片:Vanja Čerimagić/Freelance Photographer & Videographer)

「建議查核組織利用自己的內容打造AI工具,減少AI幻覺(Hallucination)與著作權的問題。」印度查核組織《Factly》 的創辦人兼執行長杜布杜(Rakesh Dubbudu)在塞拉耶佛介紹其開發的AI工具「tagore」,該工具同樣是類似ChatGPT的AI對話平台,但主要是透過大眾媒體的數據來訓練AI。目前尚未正式對外發布。

「AI回答問題的速度非常快,比人類更擅長總結,也擅長基本的分析…所以我們思考如何利用AI的優勢來幫助我們的工作?」Dubbudu指出,為了儘可能減少AI幻覺與風險,其團隊創造非常具體的數據資料庫,並告訴AI不可以給出超越這些數據的答案。

「很多新聞組織已經累積了成千上萬的文章。我們可以先從轉換這些知識來源起步。」Dubbudu強調。

圖4:印度查核組織《Factly》 的創辦人兼執行長杜布杜(Rakesh Dubbudu,圖左)6月27日在全球事實查核峰會上介紹其開發的AI工具「tagore」。圖右為國際事實查核聯盟IFCN前副總監塔達戈勒(Cristina Tardáguila)。(Vanja Čerimagić/Freelance Photographer & Videographer)

曾在2020年疫情期間組織全球查核組織成立新冠事實查核聯盟的前IFCN副總監、巴西查核組織《Lupa》創辦人塔達戈勒(Cristina Tardáguila)也在塞拉耶佛強調,查核組織在新科技之下、團結合作的重要性。她表示,市面上已有整合查核報告的聊天機器人,但經營者具俄羅斯背景,「這個工具不應該是由會懲罰記者的國家來掌握。」

「我們手上有好的數據(查核報告),如果我們不好好使用,可能會被惡意份子濫用。」塔達戈勒目前正在四處奔走,希望可以號召全球查核組織,打造一個基於查核報告內容的「超級聊天機器人」。截至今年8月底,已有至少46家查核組織表達合作的意願。

台灣cofacts 以AI提升用戶批判性思考

在台灣,將AI運用於聊天機器人也有一些進展。如公民協力查證平台《cofacts真的假的》創辦人李比鄰今年4月也在歐洲指出,該平台除了使用AI技術進行傳言分類與搜尋,也利用生成式AI分析用戶提報的傳言——特別是還沒有相關查核結果的傳言,cofacts的AI機器人會根據分析結果,提醒用戶需要特別留意的地方。

根據查核中心記者測試,例如向cofacts聊天機器人分享一則宣稱「俄羅斯擊沉北約運兵郵船,7000多名北約士兵葬身海底」的網路傳言,儘管cofacts的資料庫尚未有該傳言的查核結果,但根據AI機器人的分析,該傳言在訊息來源、內容真實性、以及濫用文字標籤等部分,都顯示傳言可能缺乏可信度。(如下圖)

圖5:向cofacts聊天機器人分享一則宣稱「俄羅斯擊沉北約運兵郵船,7000多名北約士兵葬身海底」的網路傳言,儘管cofacts的資料庫尚未有該傳言的查核結果,但根據AI機器人的分析,該傳言在訊息來源、內容真實性、以及濫用文字標籤等部分,都顯示傳言可能缺乏可信度。(cofacts聊天機器人擷圖)

推薦閱讀