【事實釐清】網傳「接到陌生電話不要先講話,不出聲要直接掛掉,AI會蒐集民眾聲音」?

【事實釐清】網傳「接到陌生電話不要先講話,不出聲要直接掛掉,AI會蒐集民眾聲音」?

【報告將隨時更新 2024/4/12版】

AI技術日新月異,近期通訊軟體流傳一段文字訊息,提醒民眾接到陌生電話不要先講話,因為AI會蒐集民眾聲音。專家看法為何:

一、AI專家指出,目前AI技術發展快,大約5-10秒間的連續說話,能模擬出真實人聲。但實際電話通話情境,聲音品質可能不佳、容易失真;且若只是幾句「喂、你好」回應,難以製作出聲音品質佳的AI音檔。

專家建議,民眾不需要過度防備,也不需要接起電話先不出聲。

二、資安、AI專家說,對於陌生電話本來就應該小心謹慎,若擔心可能是詐騙電話,應直接掛掉,謹慎求證。民眾也可以跟家人朋友間設立「通話密語」,在接電話時,若不確定是否為親友本人時就能進行多重確認。

圖卡版

背景

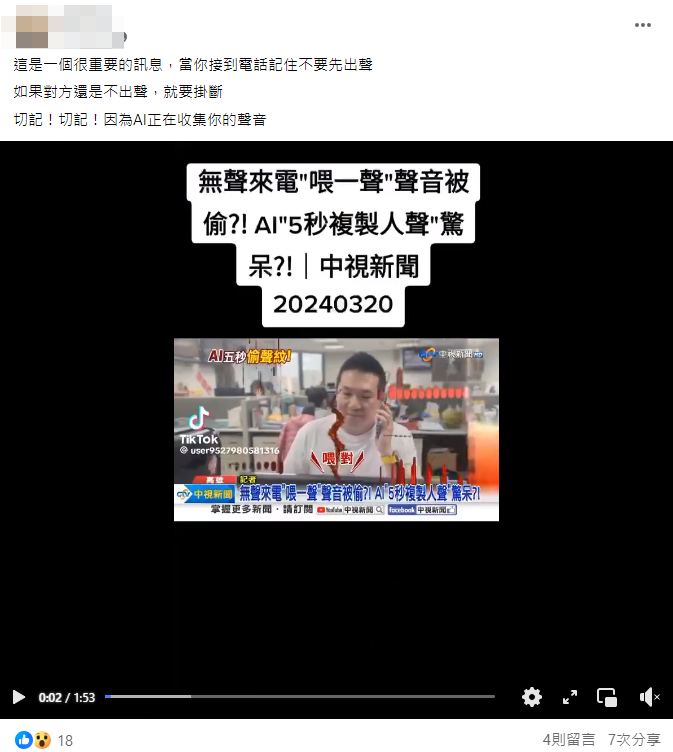

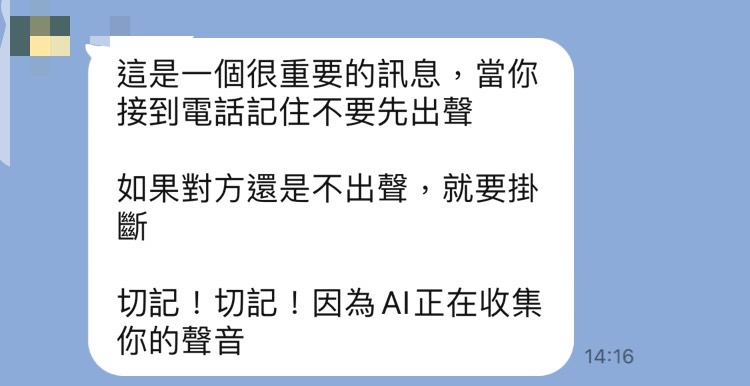

AI技術日新月異,近期Line流傳一段文字訊息,提醒民眾接到陌生電話不要先講話,若對方不出聲應直接掛掉,因為AI技術會蒐集民眾聲音。民眾流傳時,多會搭配新聞影片、報導連結。

圖1-2:社群平台、通訊軟體流傳訊息擷圖

查核

查核點一、陌生電話用AI複製聲音?接電話都不要先出聲?

成功大學統計學系教授許志仲說,現在AI技術發展快,大約5-10秒間內模擬出真實人聲。但是實際上,電話聲音品質差、容易失真;且若只是1-2句電話問候語,也很難做出品質佳的AI聲音。因此,民眾可以小心,但毋須過度擔心、過度防備到先不出聲。

許志仲說明,現在AI聲音影像犯罪的案例愈來愈多,但多是利用名人聲音、影像製作的詐騙案件,因名人公開影像多,很容易製作成AI。至於一般民眾,現在也會有詐騙集團利用AI,模擬家人聲音借錢等案例,但是比起其他詐騙手法,還是少數。

資安專家、Whoscall資深產品策略協理劉彥伯說,傳言立意良善,但過於誇張。現今AI聲音技術確實可以在5-10秒內,模擬出真實人聲。但是這5-10秒之間是要連續不斷地談話、情緒抑揚頓挫,AI才能有效學習。

因此,若只是單純接起電話說「喂」、「你好」,不至於立馬就能讓AI模仿聲音。但如果民眾覺得電話可疑、或是疑似詐騙電話應直接掛掉,不要跟他繼續對話。

資安院資安專家指出,觀察國外AI技術趨勢,大約在1年前就能利用短短5-10秒聲音,做出AI擬聲,可想,現在技術更為發達。

不過,傳言提到的情境可能會讓效果打折,主要是因為電話聲音品質差,再來通常接電話的問候語極短。即使能做出AI擬聲,可能也不太像,品質差。民眾確實應小心陌生電話,但毋須過度防備。

如何防止AI詐騙電話?

劉彥伯說,要防止詐騙電話,可以先安裝防騷擾電話的軟體,從源頭防制。另外,也可以跟家人親友間設立通話密語。此外,詐騙集團要能成功行騙,也需要了解個人的身家背景,套出個人習慣等,民眾也須小心,不要為了想跟詐騙集團「玩」而跟他們聊天,避免被套出個資。

劉彥伯說,民眾日常對陌生電話確實應小心,但也並非所有的陌生電話都是詐騙,也可以先求證電話號碼是否正確,或向165專線等防詐單位查詢。若聲稱是政府、企業單位打電話來,應向該單位求證。