中國社群製造俄羅斯複製人 假敘事販賣白人美女與中國情懷

記者/馬麗昕 ;主編/陳偉婷

一名中國網友滑開他的小紅書帳號,印入眼簾的是一支支金髮碧眼的美女影片訴說著「中國男生願意娶俄羅斯女生嗎?」、「在中國生活的8年已經深深改變了我」等論述,大力放送親中言論。

這些影片暗藏玄機,是運用深僞技術假冒俄羅斯美女混淆視聽。近期一位烏克蘭女性網紅Olga就拍影片向大眾宣稱「自己的影像被中國社群平台盜用」,利用AI深偽技術大量複製定居在中國、愛中國的的俄羅斯女性帳號,流竄在各大中國社群平台如Tiktok、小紅書、微信影音號。

該名烏克蘭籍網紅不是唯一的受害者,實際上有更多的白人女性被「複製」(Cloned)。這些被稱為娜塔莎、安娜、捷琳娜的俄羅斯女性,有一樣的人設,一樣喜歡中國,一樣說著一口流利的中文,也都是利用AI深偽技術,盜用真實存在的女性影像編織出來的謊言。

中國社群出現大量假俄羅斯人 網紅、學者皆受害

烏克蘭網紅Olga Loiek今年2月期間拍攝影片,揭發中國社群大量流竄著她的深偽影像假帳號,化名為「娜塔莎進口食品」、「April安娜」,引起歐、美等各國關注。這些帳號都有近萬人追蹤,但目前已被刪除、下架,查核中心也在3月1日發布查核報告。

不只Olga被造假,使用關鍵字如「定居中國俄羅斯人」、「喜愛中國」、「努力學中文」、「賣俄羅斯食品」等在中國社群平台搜尋,可以找到更多類似的「俄羅斯人」。

部分帳號比對可發現是盜用Olga影像,但更多帳號臉部明顯不是Olga,這也代表有更多的白人女性影像被盜用。

.jpg) 圖:中國社群出現大量複製人/查核中心製圖。

圖:中國社群出現大量複製人/查核中心製圖。

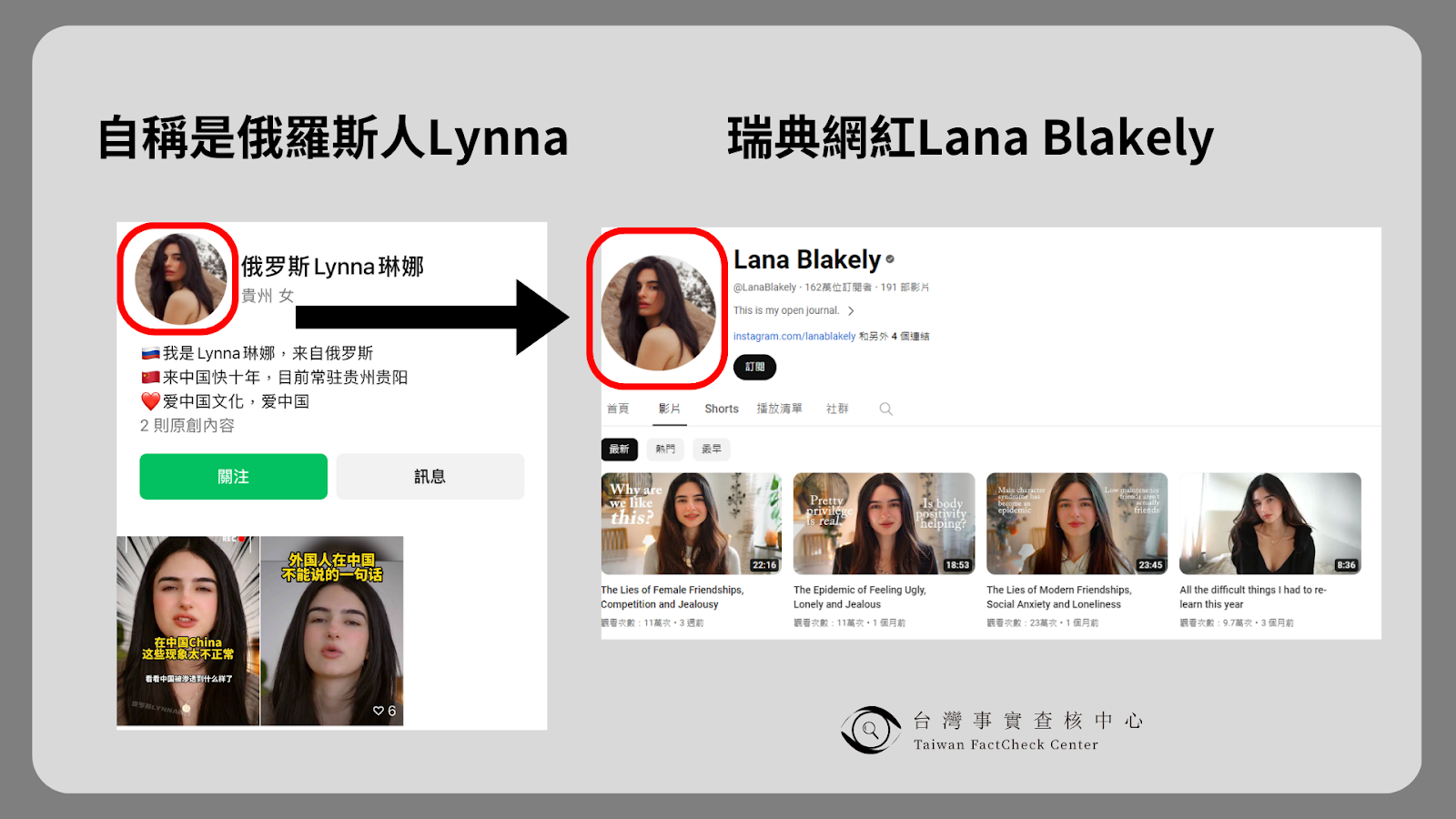

例如,微信影音號一自稱是「Lynna琳娜」的俄羅斯人,也有類似的發文模式。自稱愛中國、定居中國10年。但實際搜尋她的影像,其實是盜用另一名瑞典網紅「Lana Blakely」的影像。

圖:自稱是Lynna的俄羅斯人其實是瑞典網紅/查核中心製圖。

圖:自稱是Lynna的俄羅斯人其實是瑞典網紅/查核中心製圖。

除了多名網紅深受其害外,美國知名法律學者也是受害者。

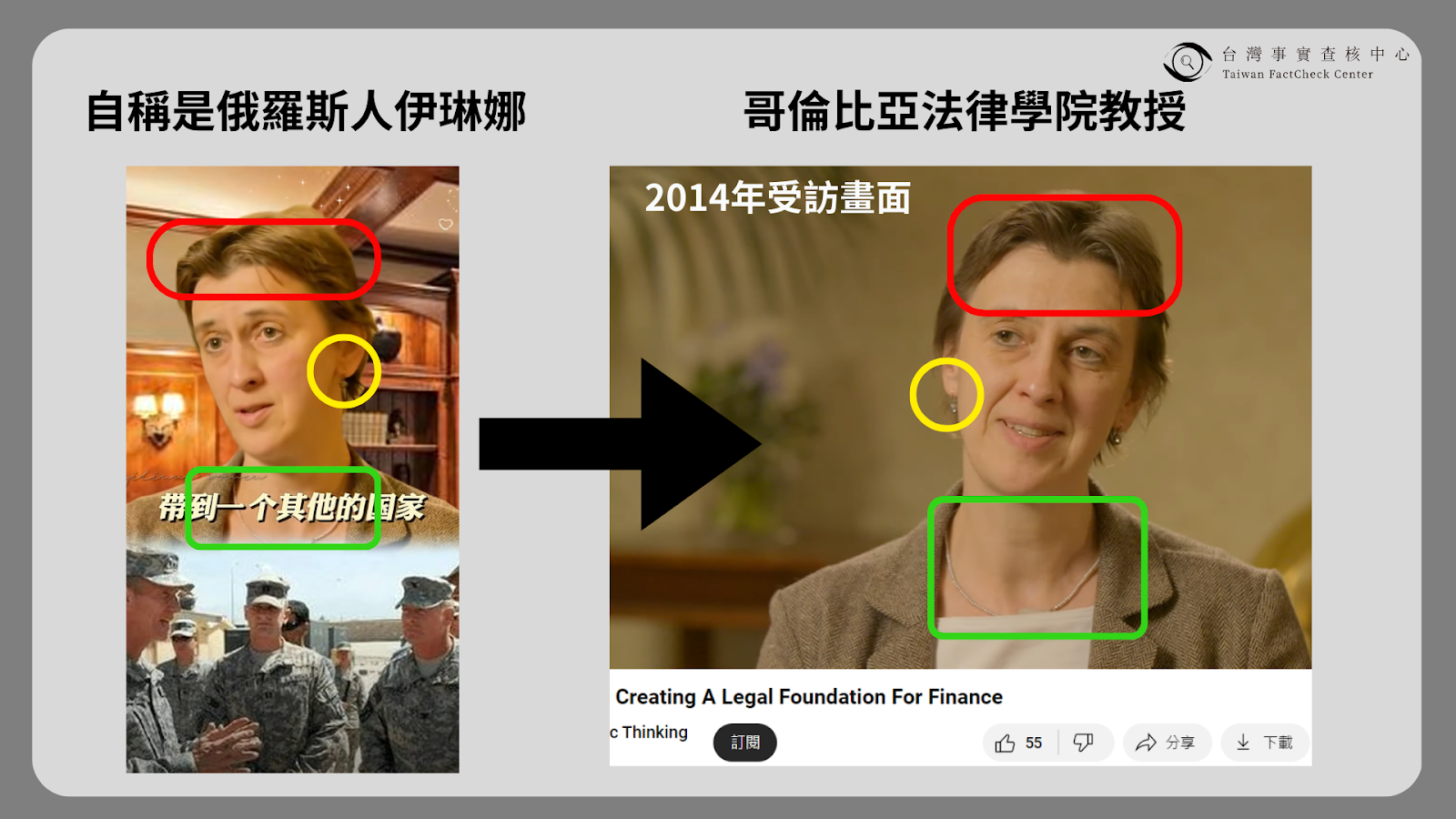

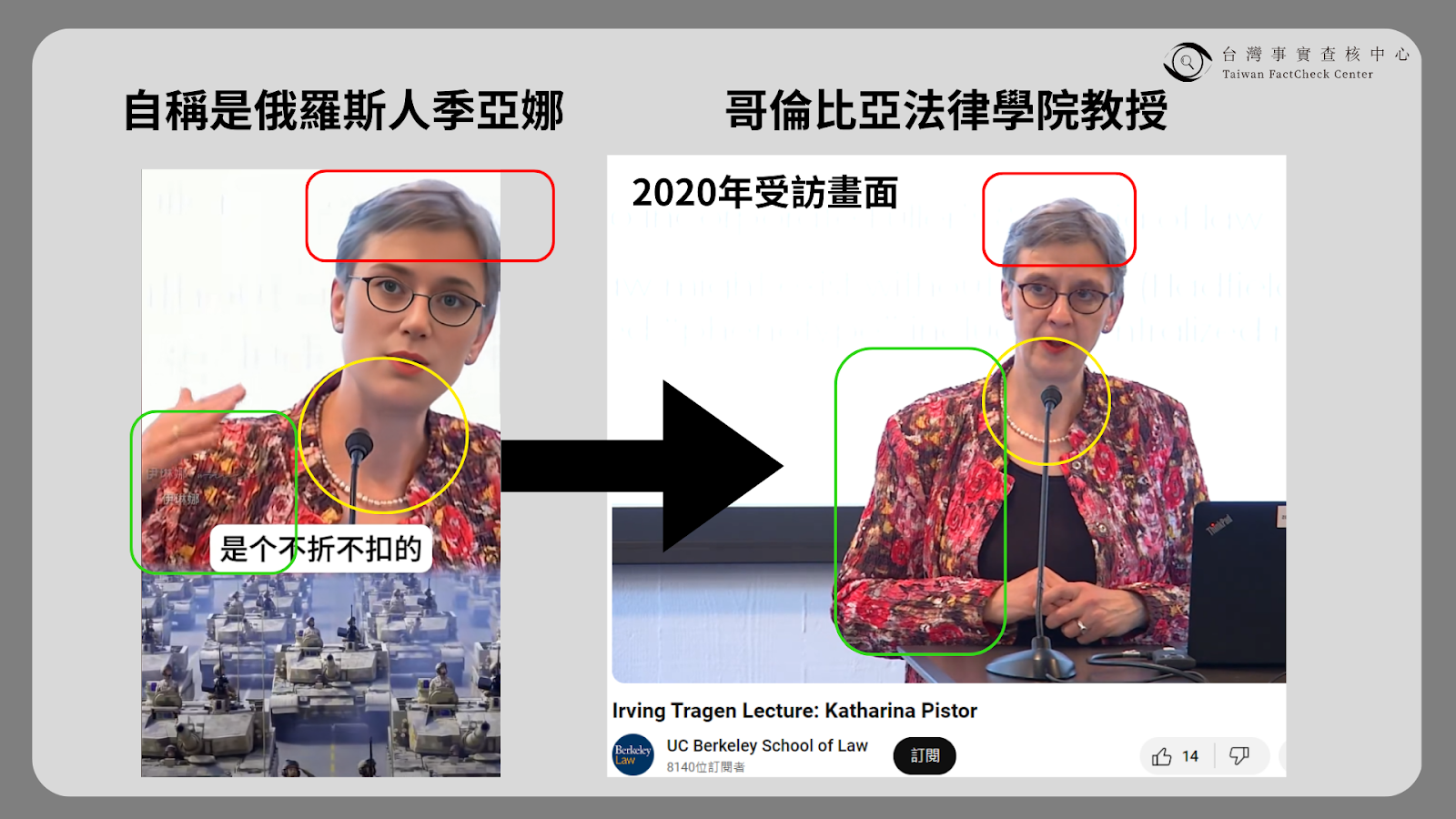

微信影音號一自稱是「季婭娜」的俄羅斯人,有俏麗頭髮,宣傳著中國文化的優點。轉換到抖音平台,與「季婭娜」擁有同一張臉的抖音帳號,則化名成「伊琳娜」,同樣販售著愛中國情懷。

然而,不管是「季婭娜」還是「伊琳娜」,搜圖調查後發現,她們的真實身分是現任哥倫比亞法學院教授卡塔琳娜·皮斯特(Katharina Pistor)。中國社群上的假帳號是盜用她在2014年、2020年公開受訪、演講的畫面。

不只她們,目前中國社群平台仍可看到許多白人女性被盜用影像,假影片無限繁殖。

圖:自稱是伊琳娜的俄羅斯人,實際為美國哥倫比亞法律學系教授塔琳娜·皮斯特。

圖:自稱是季婭娜的俄羅斯人,實際為美國哥倫比亞法律學系教授塔琳娜·皮斯特。

盜用真實女性影像 用AI打造出的假俄羅斯人

觀看這些「俄羅斯人」的影片,可以歸納出幾個明顯劣假的手法。例如每支影片的衣著,講話時的肢體動作幾乎一樣;講話時眼睛對焦不自然,部分影片也沒有自然的眨眼動作。

造謠者竊取真實人物的公開影像,再利用深偽技術,將談話內容從英文轉為流利的中文,影片中的女性則呈現出無瑕疵的容貌。最後加上相關配圖、斗大的標題文字,打造出定居在中國的俄羅斯人。

成功大學教授副教授許志仲也協助偵測多支影片,分析結果顯示,這些影片都有深偽痕跡,屬於換臉技術的一種。

「近期常有美國知名藝人『開口說中文』的影片就是類似手法」,許志仲說,造假影像利用人物的真實影像,再用影音合成。網路都有現成AI工具,非常容易變造。

圖:社群也流傳出現「習近平說流利英文」的AI影片,民眾誤以為真。

許志仲分析,可以觀察到這些頻道的生產品質比以往更好,深偽造假影片增加的速度越來越快,很難遏止斷絕。

截至目前,記者觀察這些假俄羅斯人帳號、影像並無斷絕的跡象。雖然主要造假帳號已被下架、刪除,但分身帳號仍遊蕩在各大中國社群平台,成為被盜用女性的巨魔陰影。

造假敘事的3種交織:白人女性、中國宣傳、商業利益

分析此次造假帳號宣傳的敘事,可以整理出3大敘事特徵:

首先,所有的假俄羅斯人都是「白人女性面貌」,她們看似是單身女性,來到中國定居。

第2敘事特徵,她們千篇一律地喜愛中國、宣傳著俄國女性的「美好特質」,欽羨中國男性的強壯特質。

第3個敘事特徵,她們的職業是自營商,販賣俄國食品、經營個人商業的俄國女性。

此外,這些影片也外溢到其他內容網站。如中國網易平台也將這些假帳號包裝成「俄國女孩向中國男性求愛」文章,藉此抬高假俄羅斯人在中國社會的地位,甚至貶低中國女性的價值。

圖:中國網易平台假敘事擷圖

儘管這些影片有明顯的破綻,如嘴型、眼睛等,甚至有些帳號會標註是AI合成,但在影片下方留言的讀者似乎並未察覺,或是並未在意是真是假。

關注數位性別暴力、政大傳播學院副教授方念萱則指出,從過去的深偽影像案例發現,人們不一定在意這些影像是真是假,重點在於觀眾在觀看影片當中是否得到「滿足」。

方念萱也提到,前陣子X平台上也出現泰勒絲(Taylor Swift)的深偽造假色情影像事件,當時引發大量泰勒絲粉絲抗議,X平台一度禁止搜尋「Taylor Swift」的名字,以防止造假影像傳播。

圖:X平台上出現美國歌手泰勒絲深偽色情影像/達志影像

從泰勒絲到假俄羅斯人案例,方念萱分析,這些女性的面貌是典型的「完美」女性形象。

方念萱說,儘管此次的假俄羅斯人影片並非用作色情,但也利用了「美麗女性」樣貌;販賣的故事,也是典型「外國人愛中國」中國內部宣傳套路。

這幾層敘事的交織,滿足了中國網友對於他國國家女性,還有大中國的慾望。

正視Deepfake的危害 閱聽眾要學會主動辨認

相對於泰勒絲的知名度,容易受到外界關注,得以讓假影片不再擴散。但這些被造假成俄羅斯女性者並非全球知名,閱聽眾難以知道她們的真實身份,且也沒有足夠影像力驅動影像下架。

方念萱指出,名人網紅不斷曝光自己的影像,源源不絕的素材也助長被挪用、複製的造假風險。隨著Deepfake日常化,女性不斷被當作造假素材,觀眾可忍耐的程度愈來愈高時,這些受害女性將會愈顯得無計可施。「一旦閱聽眾習慣、不在意這些素材是否是假的,將會讓情況更惡化。」

長期關注深偽案例的許志仲也同樣指出,「類似的案例未來只會越來越困擾。」對於許多人來說,觀看這些影片其實是用很短的時間獲取他們想要的答案,很少人會真的去仔細觀察影片是否有破綻。

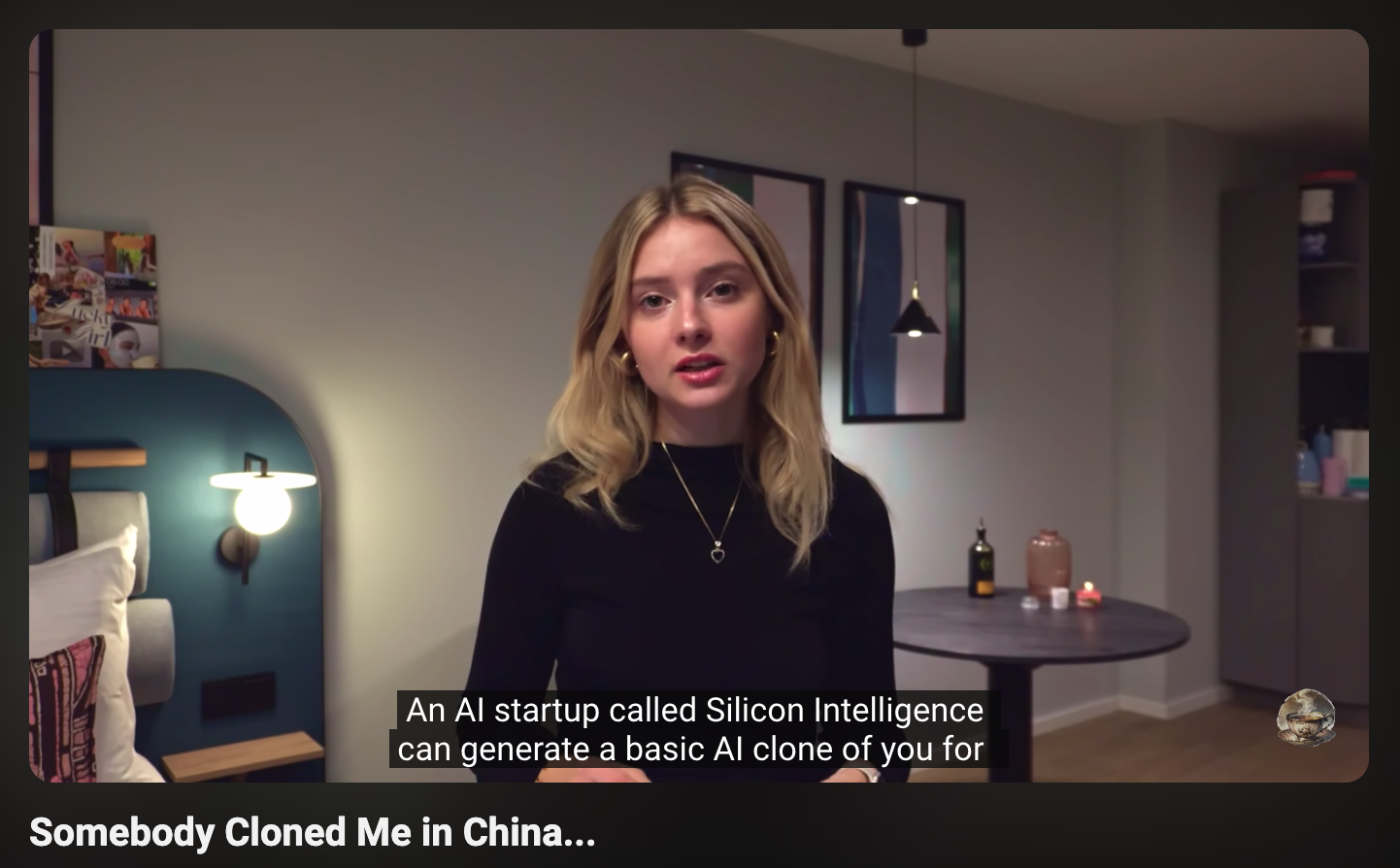

烏克蘭網紅Olga被偷臉後,拍攝影片完整地分析自已是如何被造假,甚至也向她的粉絲解釋什麼是AI?什麼是Deepfake?把自身經驗作為媒體識讀的典範。

雖然無法遏止自己的影像被盜用,但確實讓閱聽眾了解深偽對個人造成的危害。

圖:Olga分析AI如何複製別人的影像/擷自Olga的YouTube影片

面對此現象,許志仲老師建議, Deepfake技術日新月異,但以目前的技術來看,人仍有辦法觀察、辨認。保持對影像的警覺心、學習辨認AI影像的破綻,是現代閱聽眾應該擁有的能力。

方念萱則提醒,「不要僅把這一切當作科技必然的代價」,閱聽眾應主動學習辨認,這仍是當今數位時代最重要的功課。