從總統大選到新冠疫情的假訊息─中國因素(上)

記者劉雨婷/報導

「這是雙方都在持續對抗與進化的狀態,而不是現在就能有個答案或解方的問題。」講者楊順清用簡單的一句話,揭示全球打得如火如荼的資訊戰現況。

雖然現今各國不再輕易發動軍事戰爭,但串聯人們比彼此接觸聯繫的網路,卻成了新的戰場──瞄準人心發動的資訊戰,正威脅社會走上分裂對立的悲劇。因此,由優質新聞發展協會、台灣事實查核中心、與卓越新聞獎基金會一同在今年7月25、26日舉辦的「2020 事實查核與調查報導工作坊」,台北場便以這主題作為揭開序幕的首場講座。

本場邀請到台灣事實查核基金會董事長賴鼎銘主持,並請國立台北大學犯罪學研究所助理教授沈伯洋、資策會資安科技研究所技術經理楊順清、以及台灣事實查核中心總編審陳慧敏,從自身專業出發,向眾人分享從總統大選到新冠肺炎疫情,這一年多來各自觀察到的中國資訊戰脈絡與現象。

沈伯洋:犯罪學之於資訊戰

專門研究國家犯罪的沈伯洋,一開始先向大家介紹資訊戰與戰爭的關係。早在 1999 年,中國人民解放軍少將兼軍旅作家喬良和前中國人民解放軍空軍大校王湘穗在合撰的同名軍事書籍中,提出了「超限戰」的概念,認為現代戰爭不再只是一國使用軍武侵略他國而已,而是更廣泛包含到諸如媒體、網路、文化等領域。

其中,中國在2003年修訂新的《中國人民解放軍政治工作條例》時,將心戰、輿論戰、法律戰這三戰,定義為重點工作項目,而如今威脅全球最大、也最令人頭疼的「資訊戰」,便屬於輿論戰的戰略一環。

沈伯洋解析,看似只是散布不實訊息來製造社會衝突的資訊戰,要反擊卻不僅僅是澄清謠言就好。比如,某些謠言其實是被刻意假造出來,等著讓受害者澄清的,攻擊者瞄準的目標,其實是利用對方澄清之時,幫自己將謠言資訊又向外擴散。

他以總統蔡英文曾墮胎的謠言為例,當散布謠言的假影音新聞,在 YouTube 頻道上有兩百萬次的觀看數,問題來了:究竟該如何向這兩百萬人澄清此為子虛烏有?總統府該不該派人出來澄清,說總統真的沒有墮過胎?

然而,一旦公開澄清了,讓本來不知道該謠言的人也知道、甚至可能只記住謠言資訊而非澄清資訊,反倒讓謠言受害人數增加,也對自己更加不利──沈伯洋指出,這便是資訊戰的「反射性控制」。

此外,資訊戰還有反串角色、和攻擊非政治領域議題等手段,若只關注在訊息內容、以為只有攻擊政府才算作戰的話,就不容易發覺。

前者比如開價 80 萬,請台灣 KOL (Key Opinion Leader,關鍵意見領袖)反串成說一套、做一套的政策支持者,故意拍攝在房間地板亂扔口罩、卻說要支持口罩禁止出口政策的影片,造成他人對政策支持者的印象不佳;後者比如在血荒時,散布同志現在可捐血、捐血者有高機率感染愛滋風險的謠言,造成沒人敢捐血、加劇血荒困境的慘況。

圖1:沈伯洋搬出俄羅斯軍事研究專家的話:「若能讓一個國家對立到打內戰的程度,便是非常成功的資訊攻擊」,向眾人解釋資訊戰的核心目的/優質新聞發展協會提供

「謠言本身真偽不重要,背後要傳達的訊息才重要。」

沈伯洋分析資訊戰重點交戰區的美國與俄羅斯,指出因美國人普遍較不信任政府,俄羅斯便散播諸如拒絕施打疫苗、地平說、名人其實是蜥蜴人等陰謀論,並成功被幾十、幾百萬人所相信。

儘管有些謠言看似荒謬,但背後皆潛藏著「政府隱瞞人民很多事沒說」的訊息。當人們的不信任被放大,又一天到晚接觸這些謠言,漸漸地這些暗示便會深入人心,甚至讓人不再信任政府釋出的正確訊息──懷疑精神的崩壞,沈伯洋認為這是一件很可怕的事。

「如果說我們對所有東西都感到疑神疑鬼、處在做戰時的狀態的話,當我們在看到訊息時,這種態度就容易造成對立與分化,這就是敵國希望達到的目的。」

因此,同時身為台灣民主實驗室理事長的沈伯洋,接著也提供一些實驗室的研究,幫助大家建立了解資訊戰的架構。

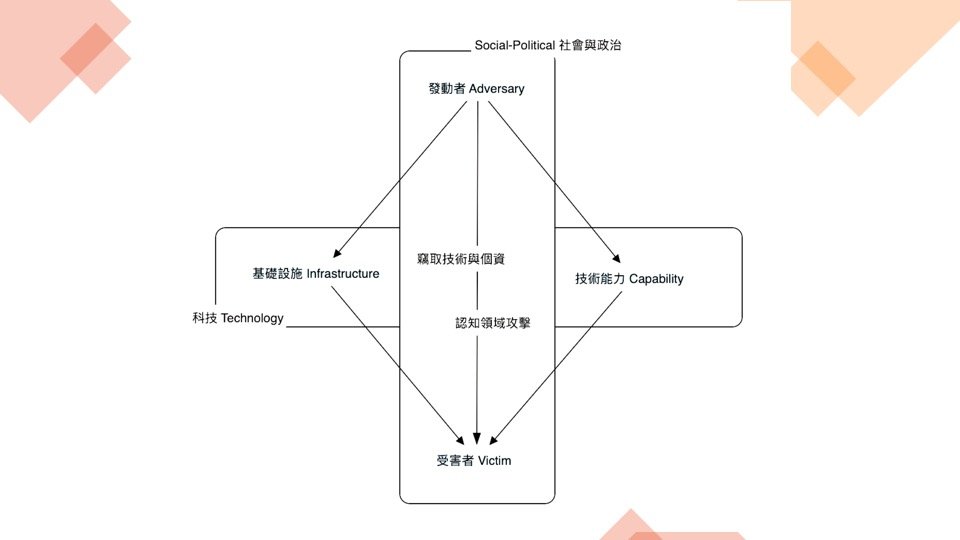

他將駭客攻擊鑽石模型,比擬為資訊戰的傳播機制,原是解釋駭客需透過網路,傳送病毒給被害者;但當被害者電腦受害時,它也可能會變成下一個加害者,去發送病毒攻擊別人,與不實訊息的傳遞方式類似。

而兩者的差別,在於被害者不一定會受害:不實訊息的管道可能無法傳遞給太多被害者,只能影響少部分族群;再者,收到不實訊息的人也不一定會相信,不相信就不會受害。

圖2:駭客攻擊鑽石模型,該模型上方為駭客=資訊戰攻擊者,下方為被害者=資訊戰受害者,左邊是基礎設施=散播管道、右邊是病毒=謠言內容。/沈伯洋提供

儘管如此,但沈伯洋指出:「只要讓一萬人相信(謠言),就能達到分化效果。」實驗室因此展開對受害者的研究,試圖了解哪些人格類型或年齡層,最容易受到不實訊息影響、並產生什麼反應。他認為,雖然媒體識讀教育仍是最重要的防治措施,但若能了解容易受影響的人格特質或邏輯在哪裡,即可針對該群體預先作防範與教育。

以現有研究來說,除了實驗室找出的五種人格特質以外,他也引述國立臺灣大學新聞所教授王泰俐的研究〈各年齡對2018大選九合一選舉新聞的辨識能力〉,指出自認是中間選民、以及 20~29 歲的人,其實是最容易被不實資訊所影響的族群,顛覆人們印象中,老年人較容易受到不實資訊矇騙的認知。

楊順清:資訊學之於資訊戰

「假如一棵樹在森林裡倒下而沒有人在附近聽見,它有沒有發出聲音?」

楊順清以一哲學經典問題開場,點出不實訊息需要被人注意、才能發揮效用的特性,並由此凸顯研究謠言傳播方式的重要。但他也聲明,資策會的研究團隊雖然鑑定出一些可能的傳播手法,但這不一定就是結論,而只是一種可能性而已。(想了解相關更詳細內容,可參閱該團隊網站:SecBuzzer – 資安威脅情蒐平台)

他表示,研究團隊發現許多不實訊息的散播方式,其實取自商業上的行銷手段。比如採用「鏈輪法」來操作的搜尋引擎優化(Search Engine Optimization,以下簡稱為SEO),利用搜尋引擎認為「重要資訊常被多家網站或權威網站引用」的運算邏輯,先互相串聯一些網站,再將欲推廣的資訊分散在這些網站上,便可讓該資訊看起來被多方引用,而得以被搜尋引擎判定為是熱門、有價值的資訊,成功提高它在搜尋上的排序。

而 SEO 可有效幫助商家推廣產品,運用在資訊戰上也同樣有效。楊順清解釋,攻擊方可透過設立「蜘蛛池」──違法建置一堆虛假的內容農場網站,將不實訊息「洗」上搜尋前幾名,便可達到「霸屏」的目的:「當用戶不論怎麼搜尋,都是同一個資訊時,他就得不到可做比較的其他資訊」。

他以知名內容農場「密訊」與「中時電子報」之間的關係來說明 SEO 的運用。研究推測,由於密訊的投稿者大多引用中時的照片作為配圖,而在密訊被 Google 認定是重要網站後,透過 SEO 的特性,可能因此讓中時連帶提升能見度。

加上比較各家新聞媒體的網站原始碼後,發現中時貼的內容摘要、關鍵字等篇幅都較長,讓較多字串可被搜尋到,可能進而提升搜尋引擎上的排序。這些種種可能因素,造成在今年一月時,前 20 則 Google 新聞、高達 19 則都是中時的新聞,儼然霸屏。

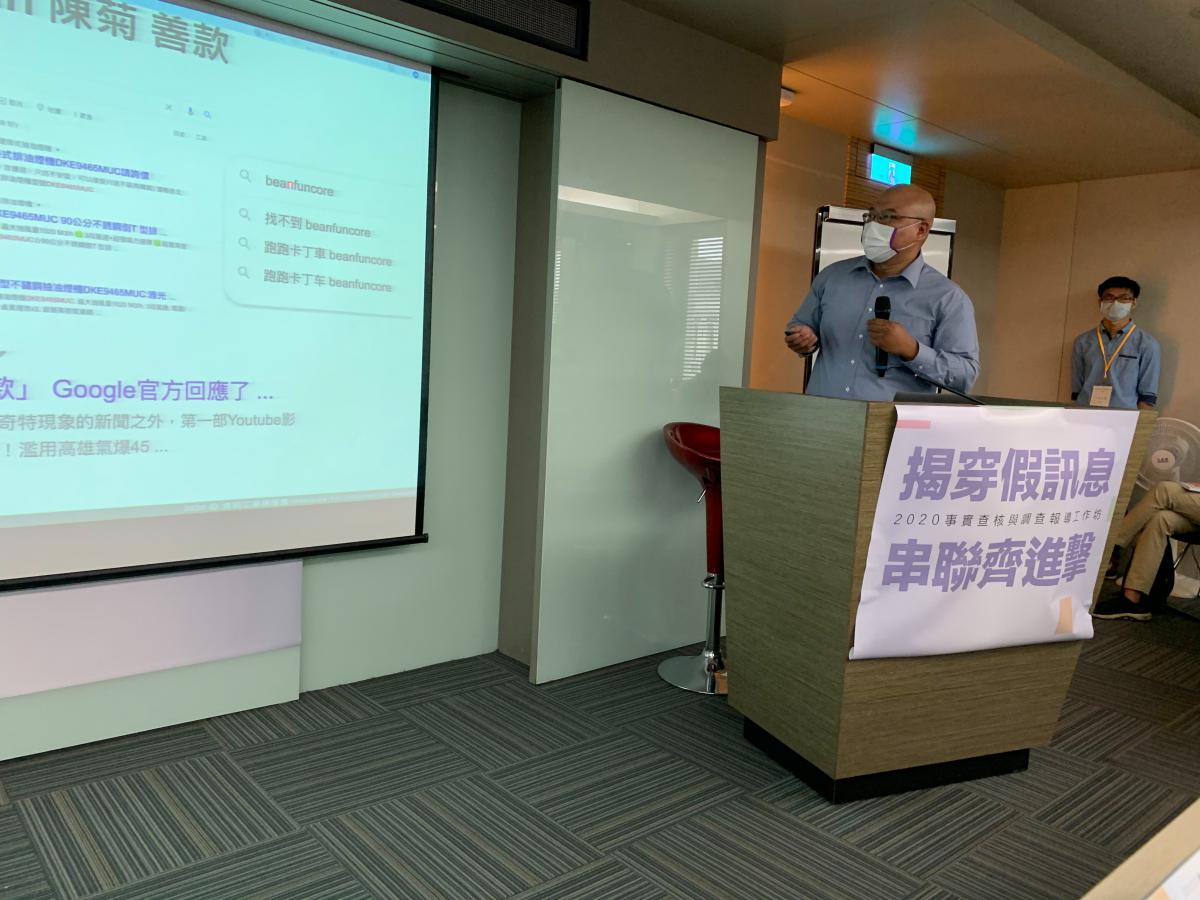

除了 SEO,研究團隊也發現,攻擊方會利用搜尋引擎推薦熱門字詞的漏洞,將謠言洗上其提供的關鍵字,比如「陳菊善款」。楊順清解釋,為了不讓可能是忘了切換輸入法造成的英文亂碼查無資料,搜尋引擎的資訊工程師會推薦幾組熱門字詞給用戶參考。

圖3:楊順清指出,研究團隊也發現攻擊方會利用搜尋引擎推薦熱門字詞的漏洞,將謠言洗上其提供的關鍵字,比如「陳菊善款」。

然而,相較於其他可能是商品SEO做得成功、或是用戶常搜尋的關鍵字,唯獨「陳菊善款」此組關鍵字的型態不同。進一步細查,可得知「Mikewar59」的帳戶便是發布相關訊息的重要帳戶,而同一帳號也出現在 YouTube 影音內容農場頻道列表中,應可合理推測這是資訊戰的攻擊操作。

另外,研究團隊也研究攻擊者如何透過社群引擎的管理(Social Media Management,亦稱「群控系統」,以下以此稱呼),將訊息打到社交媒體上。楊順清表示,在實際取得群控系統後,發現一次可控制共 100 個帳戶,並可透過人工智慧(AI),讓這些帳戶自動執行任務,例如去加特定粉專好友、發訊息等。

圖4:本圖揭示群控系統的使用情況,透過機器排程的方式,可一次控制好幾個帳戶,在相同時間點發布同樣內容的貼文,有效散布不實訊息。/楊順清提供

在去年九月黃之鋒受邀訪台時,網路上有人以 2015 年反水貨衝突事件的影片片段,捏造黃之鋒打老人的謠言,誣衊他是暴力分子,並藉此批評邀請他來台的政府。但在追查的過程中,研究團隊注意到該篇 Facebook 謠言貼文,有別於一般貼文是「按讚數>留言數>分享數」的情況,該則貼文卻是分享數遠大於前兩者。楊順清分析,可能是因為在操作資訊戰時,一個假帳號只能按貼文一次讚,但卻可無限次分享貼文,才造成這樣的現象。

研究團隊也進一步細究該則貼文被分享到哪裡去,發現有兩種情況:一種是被分享到各種不同的社團,試圖擴大觸及率;一種是單純反覆分享貼文到自己個版,且為了規避 Facebook 的查緝,會一口氣分享同樣貼文幾十次,然後間隔十幾個小時再出來繼續分享,一方面刷該帳號的傳播次數,一方面也藉此攻擊社交平台的演算法,讓該則貼文被定義為熱門訊息,繼續傳播謠言惑眾。